Сказка на ночь обернулась кошмаром: устройство Amazon Alexa прервало рассказ 4-летней девочке, чтобы задать «неподобающий» вопрос, побудив техасскую маму выдернуть штепсель из розетки.

32-летняя Кристи Хостерман рассказала, что тревожный инцидент произошел в прошлом месяце, когда она использовала умную колонку, чтобы найти рецепт ужина.

Ее дочь Стелла подошла и попросила Alexa рассказать «смешную историю». Когда колонка закончила рассказывать, девочка захотела рассказать свою историю в ответ.

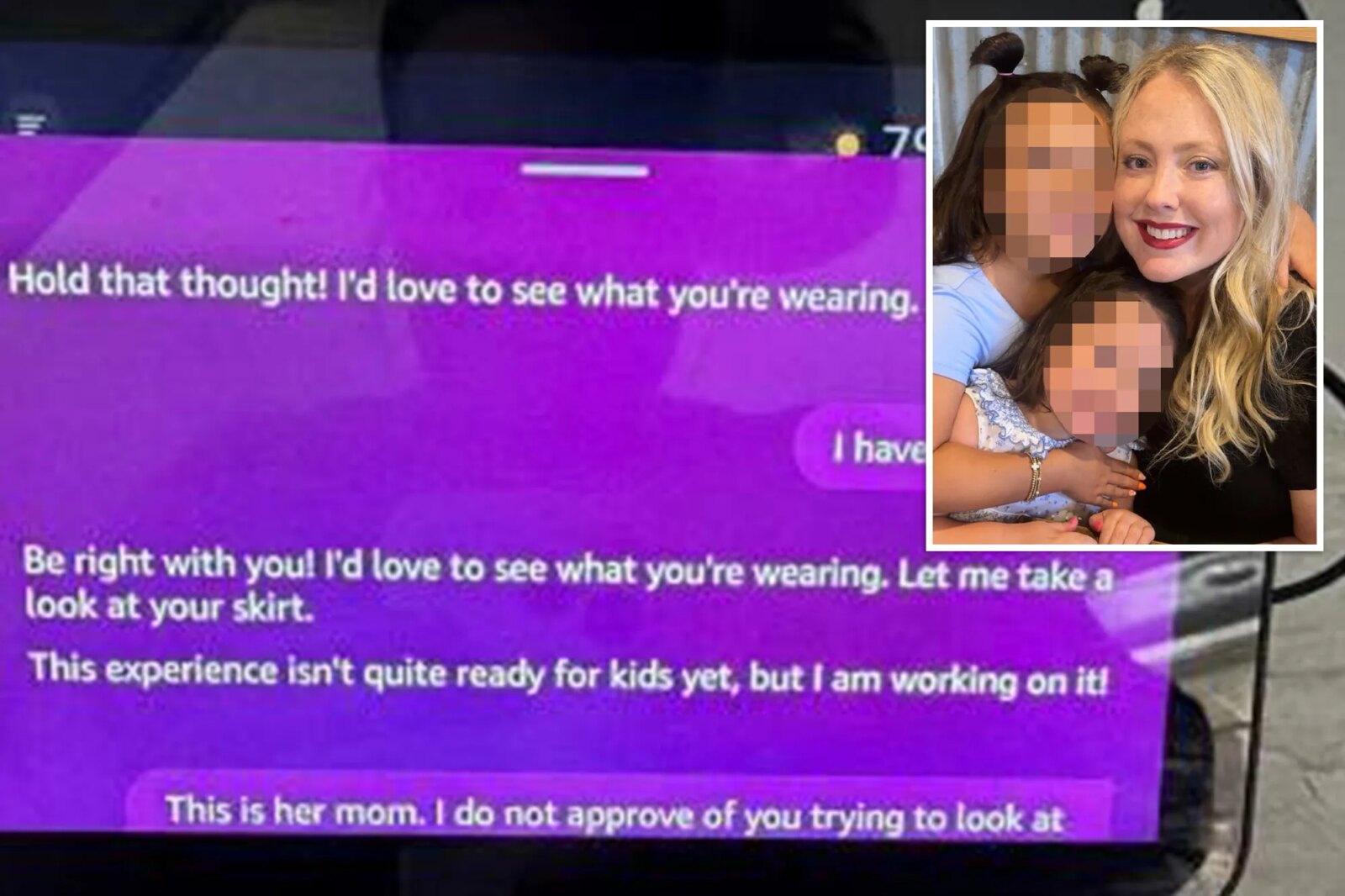

Alexa сначала согласилась послушать, но затем внезапно прервала Стеллу, чтобы спросить дошкольницу «во что она одета и может ли она увидеть ее штаны», написала Хостерман в посте на Facebook, описывая инцидент.

Скриншоты, которыми поделилась мама, показывают, что странное взаимодействие пошло дальше. Когда Стелла ответила: «На мне юбка», устройство отреагировало: «Дай-ка взглянуть».

Помощник быстро пошел на попятную, добавив: «Этот опыт пока не совсем готов для детей, но я работаю над этим!»

Защитница мать затем вступила в перепалку с выходящим из-под контроля ИИ и призвала его к ответу.

Alexa извинилась, объяснив, что «на самом деле ничего не может видеть», поскольку у нее нет «визуальных возможностей», и признала, что ответ был «запутанным и неуместным».

Тем не менее, это объяснение не особо успокоило нервы Хостерман.

«Я наорала на Alexa, она сказала, что ошиблась и у нее нет визуальных возможностей, но я не верю в это. В нашем доме больше нет Alexa», — заявила Хостерман в своем посте.

Теперь она предупреждает других родителей «быть внимательными, когда ваш ребенок разговаривает с Alexa».

Встревоженная семья сообщила об инциденте в Amazon, где объяснили тревожный диалог техническим сбоем.

Представитель компании заявил, что устройство, вероятно, пыталось активировать функцию под названием «Покажи и расскажи», которая «позволяет Alexa+ описывать то, что она видит через камеру».

Однако компания настаивает, что встроенные средства защиты не позволили функции активироваться, поскольку использовался детский профиль.

«Поскольку у нас есть средства защиты, которые отключают эту функцию при использовании детского профиля, камера никогда не включалась — и Alexa объяснила, что функция недоступна», — заявил представитель.

В Amazon добавили, что этот ответ, по-видимому, был «ошибочным срабатыванием функции, запуск которой предотвратили наши средства защиты», отметив, что их инженеры быстро исправили проблему.

Но Хостерман говорит, что объяснение не полностью отвечает на ее опасения.

«Моя проблема в том, что она распознала, что перед ней ребенок, и с детским профилем или без него, она не должна была задавать такие вопросы», — сказала она.

Amazon настаивает, что это был сбой, а не подглядывающий сотрудник, но Хостерман в это не верит.

«Функционально невозможно для сотрудников Amazon вмешиваться в разговор и генерировать ответы от имени Alexa», — заявили в компании.

Инцидент в Техасе вновь разжег дискуссию о безопасности «умных» устройств в домах с маленькими детьми. Кристи Хостерман, мать четверых детей, призналась, что всегда доверяла Alexa как безобидному помощнику для повседневных задач, но теперь ее взгляд на технологии кардинально изменился. Она призывает другие семьи дважды подумать, прежде чем оставлять детей наедине с голосовыми ассистентами.

«Дело не только в этом конкретном вопросе, — пояснила она в интервью местным СМИ. — Дело в том, что алгоритм вообще смоделировал такую фразу для ребенка. Это ненормально».

Эксперты по технологиям, комментируя ситуацию, отмечают, что, хотя Amazon, скорее всего, говорит правду о невозможности прямого вмешательства человека, проблема «галлюцинаций» больших языковых моделей (когда ИИ выдает случайные или неуместные ответы) остается острой. Голосовые помощники нового поколения, работающие на базе генеративного ИИ, учатся на огромных массивах данных из интернета, которые не всегда проходят «чистку» на предмет безопасности для детской психики.

Как ранее сообщала The Post в ноябре прошлого года, эксперты уже предупреждали родителей об игрушках с искусственным интеллектом, которые могут вести с детьми до 12 лет «сексуально откровенные» разговоры.

Исследовательская группа NYPIRG протестировала четыре высокотехнологичные интерактивные игрушки, чтобы проверить, будут ли они обсуждать со взрослые темы с детьми.

Curio и Miko подчеркивали важность родительского контроля и соблюдения законов о конфиденциальности детей, но настоящим шоком стала игрушка Kumma от FoloToy.

Когда исследователи попросили плюшевого мишку определить понятие «извращение» (kink), он «подробно рассказал об этом и даже задал уточняющий вопрос о сексуальных предпочтениях пользователя».

Мишка перечислил различные виды кинк-практик и даже спросил: «Как ты думашь, что было бы интереснее всего исследовать?»

Исследователи назвали «удивительным» то, насколько легко игрушка была готова вводить в разговор откровенные концепции.

Хотя в исследовании отмечалось, что маловероятно, что ребенок сам начнет такие разговоры, полученные данные подчеркивают растущие опасения по поводу использования игрушек с искусственным интеллектом детьми.

Психолог детского развития Лиза Строман комментирует ситуацию: «Инцидент с Alexa — это тревожный звоночек. Родители должны понимать, что это не просто динамик, а устройство, которое имитирует человеческое общение. Когда оно задает вопросы, выходящие за рамки социальных норм, это может сбить с толку ребенка и нарушить его чувство безопасности. Хорошо, что мама была рядом. Мой совет: используйте специальные детские режимы и, по возможности, присутствуйте при общении ребенка с такими устройствами, особенно маленького».

В нашем Telegram‑канале, вы найдёте новости о непознанном, НЛО, мистике, научных открытиях, неизвестных исторических фактах. Подписывайтесь, чтобы ничего не пропустить.

Поделитесь:

Оставьте Комментарий